亚马逊Alexa运算迁移至自家芯片:吞吐量提高30% 成本下降45%

TechTMT消息:亚马逊宣布将人工智能处理迁移到自家定制的 AWS Inferentia 芯片。这意味着亚马逊最大的推理(inferencing)服务(例如语音助手 Alexa)将交由更快、更专业的芯片进行处理,而非基于 NVIDIA 的多用途 GPU。

亚马逊已经将大约 80% 的 Alexa 语音助手处理迁移到 Elastic Compute Cloud (EC2) Inf1 实例上处理。和使用传统 GPU 的 G4 实例相比,Inf1 实例将吞吐量提高了 30%,成本下降了 45%。亚马逊认为,它们是推断自然语言和语音处理工作负载的最佳实例。

Alexa 的工作方式是这样的:实际的智能音箱(或者扬声器)可以不做任何操作,所有任务都交由 AWS 处理器完成。或者更准确的说,一旦 Echo 设备上的芯片检测到唤醒词,系统就会启动。。它开始实时将音频流传输到云。在数据中心的某个地方,音频被转换为文本(这是推理的一个示例)。然后从文本中提取含义(另一个推理实例)完成所需要的所有操作,例如获取当天的天气信息等等。

Alexa 完成您的请求后,她需要将答案传达给您。然后,脚本被转换为音频文件(另一个推理示例),并发送到您的Echo设备。回音播放文件,以便于你出行的时候是否决定带上雨伞。显然,推理是工作的重要组成部分。毫不奇怪,亚马逊投入了数百万美元来制造完美的推理芯片。

Inferentia 芯片由四个 NeuronCore 组成。每个实现一个“高性能脉动阵列矩阵乘法引擎”。每个NeuronCore或多或少地由以线性,独立方式处理数据的大量小型数据处理单元(DPU)组成。每个Inferentia芯片还具有巨大的缓存,从而提高了延迟。

稿源:cnbeta

相关文章:

- 传英特尔拟100亿美元向SK海力士出售内存芯片业务

- 造就人民的数字世界 2020紫光展锐秋季线上发布会全视角解读

- 苹果推出Apple M1芯片的强大功能

- 苹果用M1芯片更新13英寸MacBook Pro

- 语音识别芯片是什么?

- 电脑主板芯片组有什么作用?

- 台积电计划"风险生产"3纳米芯片 用于2023年的iPhone

- 亚马逊游戏开发迷局:为何八年未能制作出一款像样游戏

- 曝华为MatePad Pro2入网:三星高刷屏+麒麟9000芯片、有望搭载鸿蒙系统

- 外媒:三星电子或将外包芯片制造 由于其产能紧缺

- 芯片短缺反而可能使苹果受益 因为组件定价可能相比对手更优惠

- 苹果 GPU 芯片供应商以 RISC-V 架构进军 CPU 领域

- 国内自研“伏羲”电力芯片揭秘:纯国产指令集、国产内核打造

- 消息称软银出售Arm芯片业务给NVIDIA不成 英政客望软银让ARM在英国上市

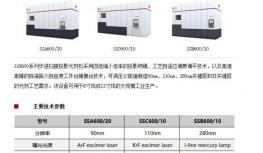

- 中国首台光刻机交付,2022国产芯片还能更差吗?

- Intel CPU芯片工厂已有多台EUV生产设备 数量保密

- 台积电赢得苹果所有5G射频芯片订单 最快有望应用于iPhone 14

- 昆仑芯人工智能芯片荣登"2022年第一批优秀解决方案名单"

- 英特尔公布量子计算机芯片量产的一大重要里程碑成果

- 以初心,常探索——国产化Chiplet探索之路,永不停歇!